MaxKB安装和使用体验

MaxKB是和1panel一个团队开发的,想起来了以前使用cpanel、da、WDCP、AppNode啥的面板时候了,一转眼又已经过去好多年了。现在时代发展了,来做知识库面板好像也不是不行,算是很对口了。

MaxKB也提供了很完善的安装文档,我在此处选择的是离线安装,步骤可以参考官方文档:离线安装 - MaxKB 文档

写本文时,最新的版本是1.10.1-LTS 版:

下载后是-offline.tar.gz结尾的压缩文件。

# 进入指定目录,解压

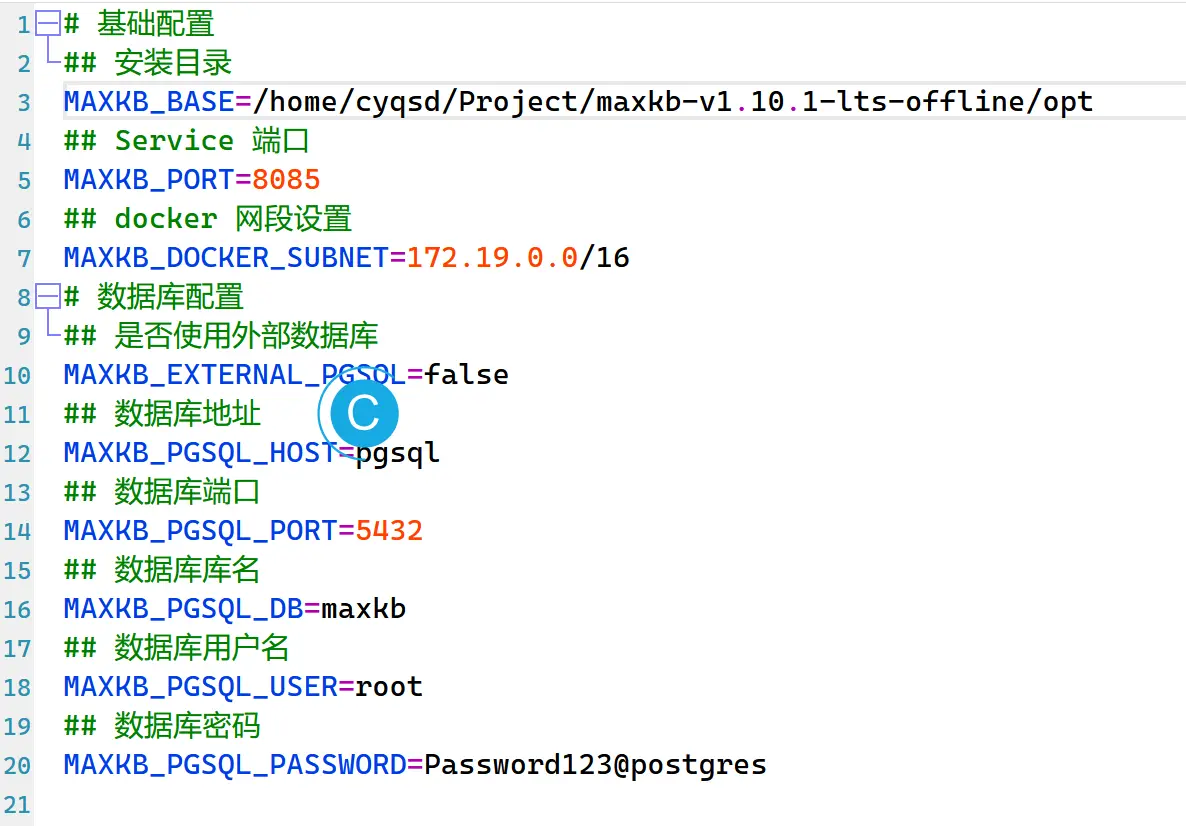

tar -zxvf maxkb-v1.10.1-lts-offline.tar.gzinstall.conf中是配置文件,如果需要修改默认配置,可以先修改。

PostgreSQL的默认密码、默认端口啥的还是可以改的,如果只是本地测试那也无所谓了。

# 运行安装脚本

bash install.sh这个安装脚本功能蛮全面的,放开防火墙,docker-compose的安装全做了。。。要是自建的时候没配置好环境,这个也一并自动做了。。。

安装完毕后就是这样:数据库是使用的PostgreSQL,相对于RAGFlow已经轻量化很多了。

CONTAINER ID IMAGE COMMAND CREATED STATUS PORTS NAMES

0e2236904b16 1panel/maxkb:v1.10.1-lts "bash -c 'rm -f /opt…" 9 days ago Up 9 days (healthy) 5432/tcp, 0.0.0.0:8085->8080/tcp, :::8085->8080/tcp maxkb

e4394ff18c59 1panel/maxkb:v1.10.1-lts "docker-entrypoint.s…" 9 days ago Up 9 days (healthy) 0.0.0.0:5432->5432/tcp, :::5432->5432/tcp, 8080/tcp pgsql

配置ollama

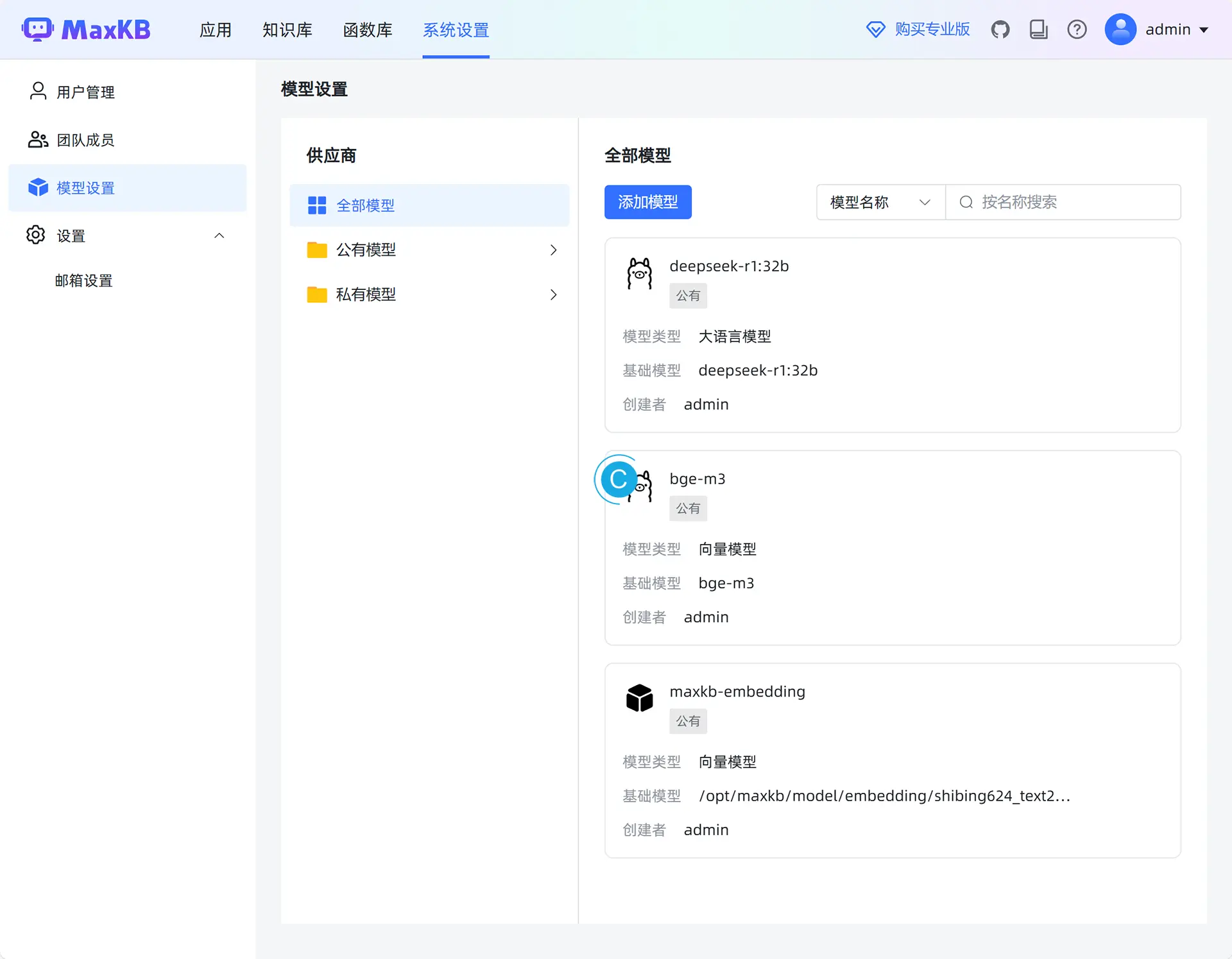

进入http://你的域名:8085/,并登录,就可以开始配置模型了。

此处测试的模型是:

- 嵌入模型:bge-m3:latest

- 推理模型:deepseek-r1:32b

- API URL填局域网地址或docker地址。

- Key此处并未设置,直接随便填一个。

- 基础模型得填ollama上的全名,否则maxkb会去下载填的模型,除非你知道是在做啥。

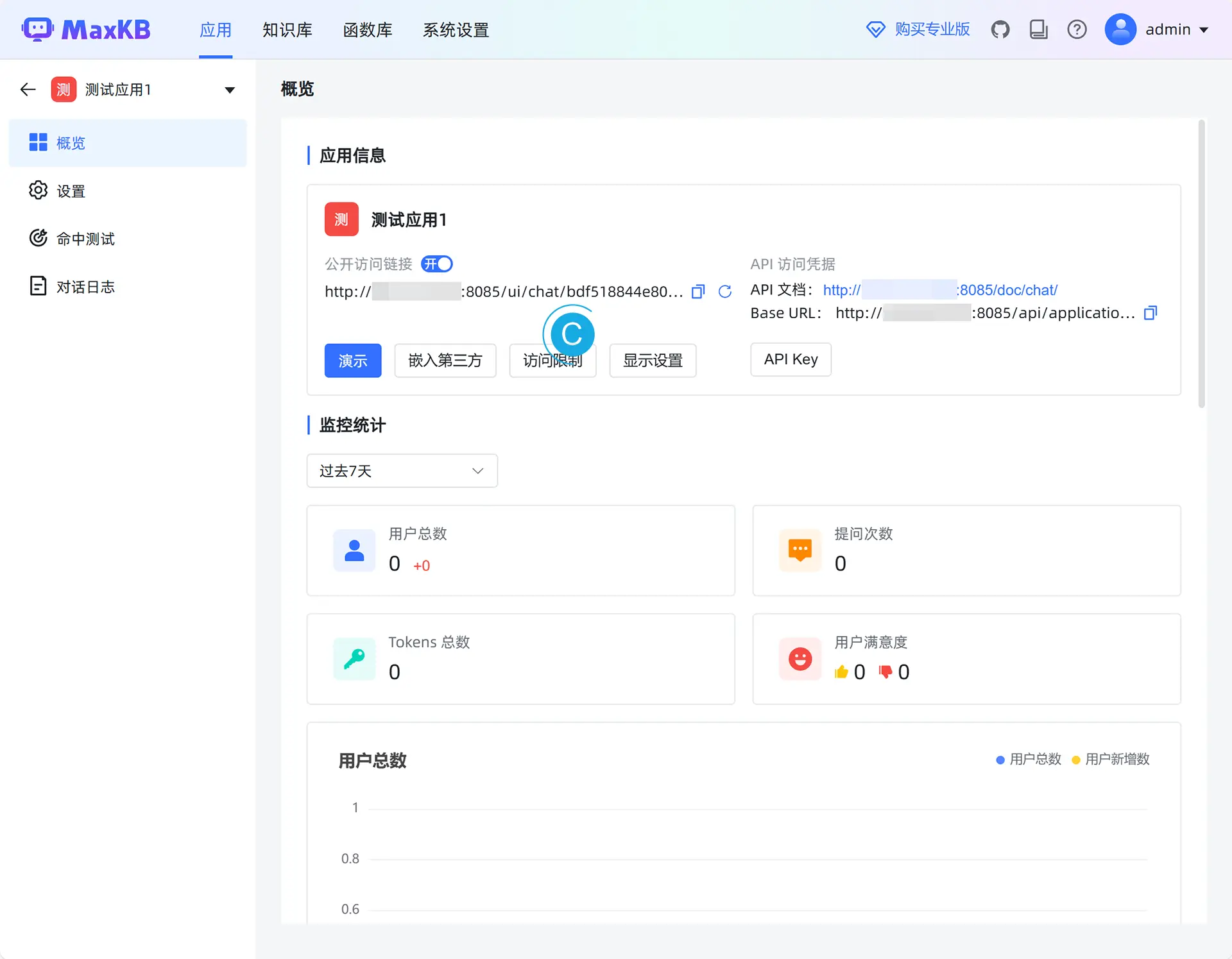

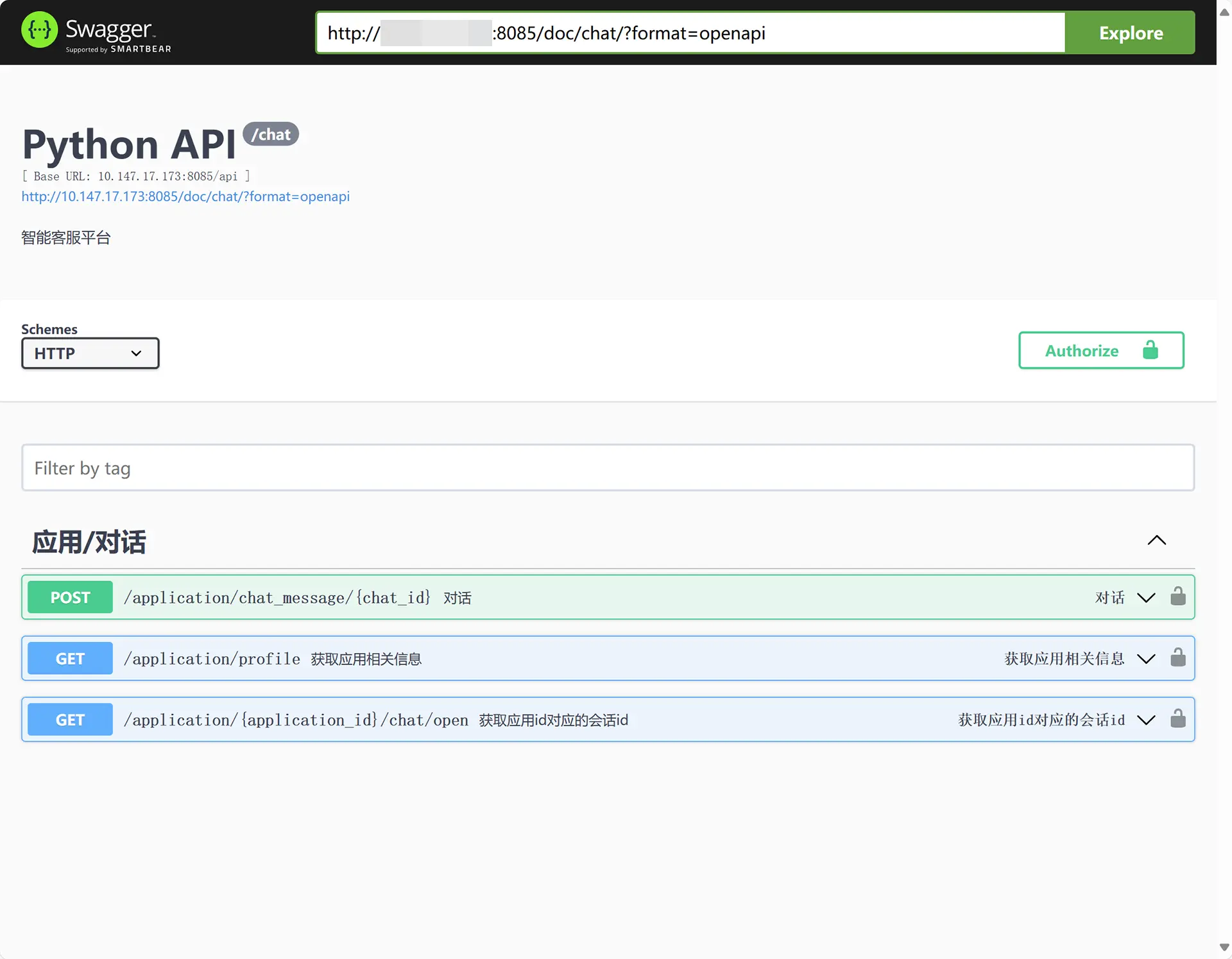

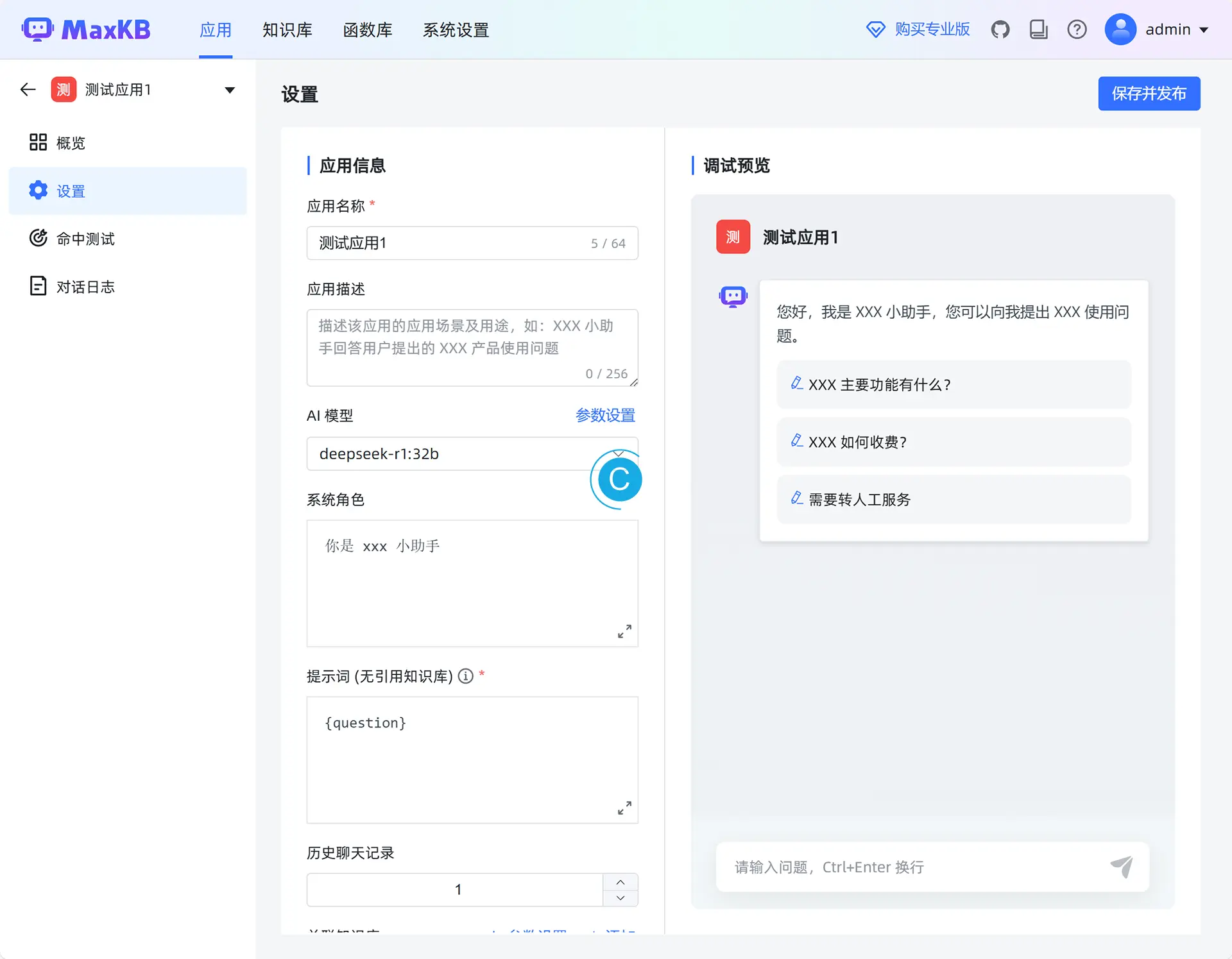

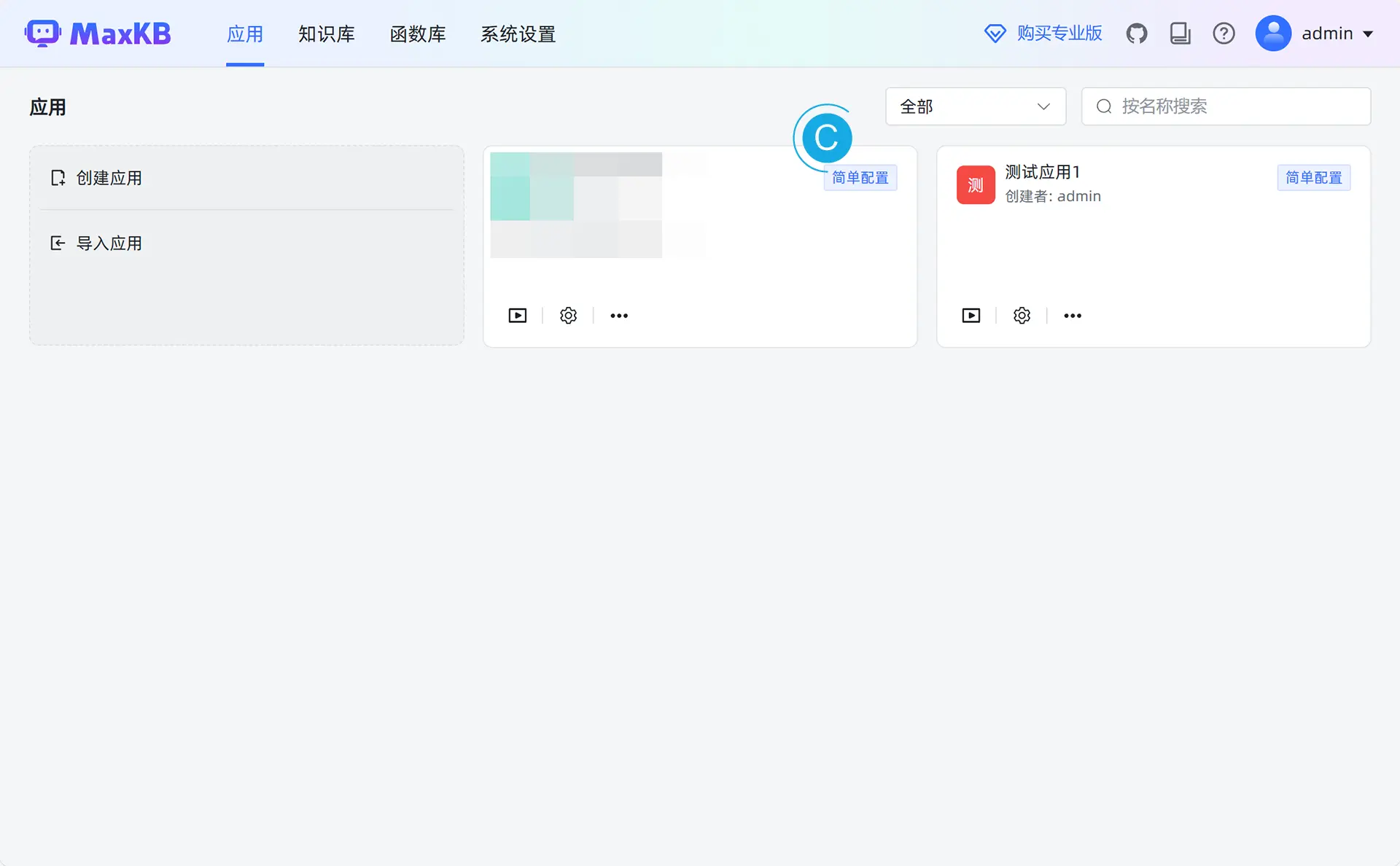

对于只是简单的问答应用,maxkb提供了很简单的页面控件嵌入或者是对话的API。

创建应用后就可以指定AI模型了,非专业版创建数量有限制。

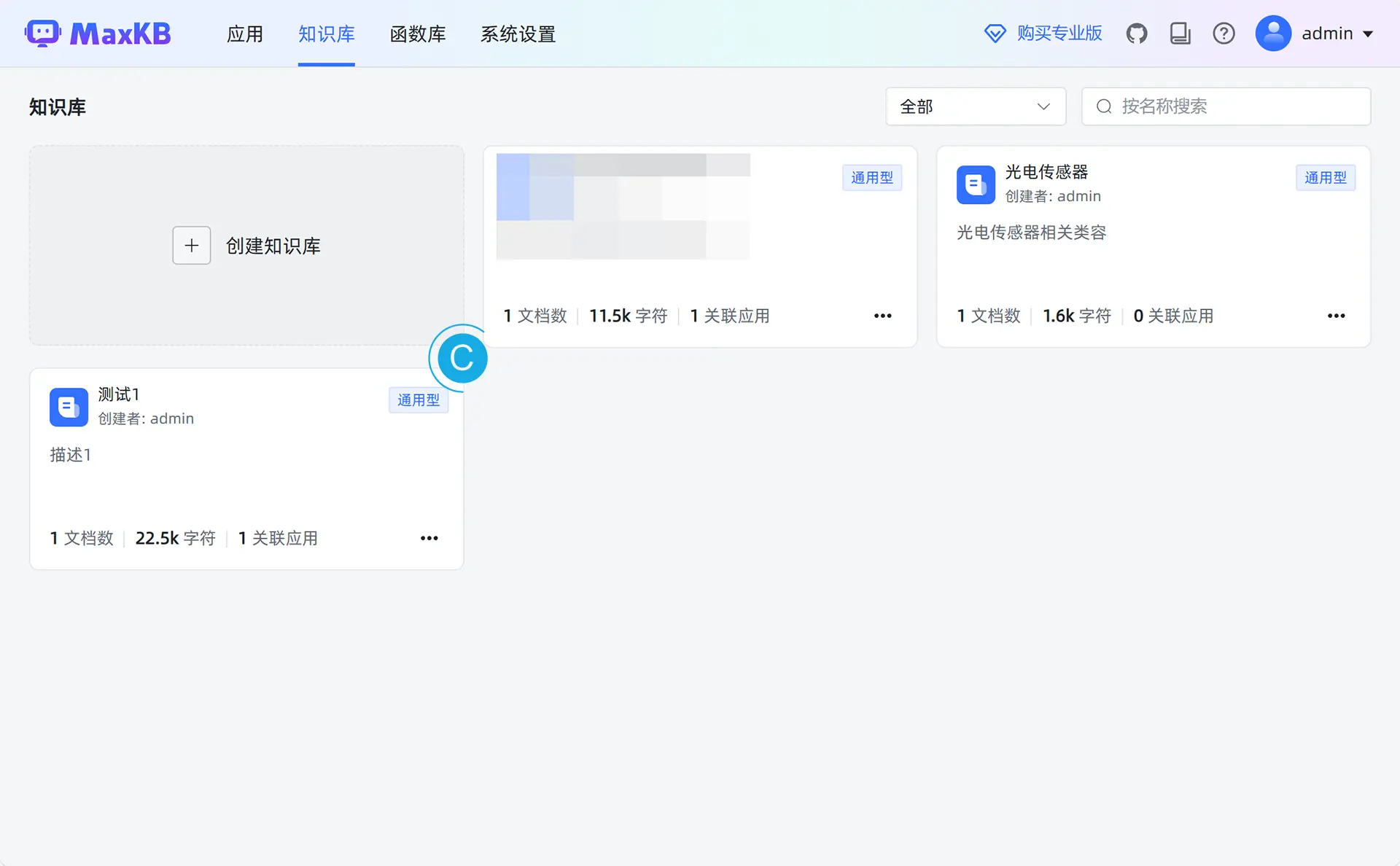

知识库的命中处理方式可以直接选择:

文档的解析上,支持的格式也比其他开源的稍多一些,本土化程度高一点。

本作品采用 知识共享署名-相同方式共享 4.0 国际许可协议 进行许可。